Máme se bát AI, aneb je ChatGPT budoucí Skynet? Myslím, že ne.

Zničí nás umělá inteligence?

ChatGPT je nejen zábavná hračka, ale i skvělý nástroj šetřící čas při mnoha činnostech, od programování až po tvorbu digitálního obsahu. Ovšem co jsme to vlastně v jeho podobě stvořili? Máme se ChatGPT a jemu podobných technologií bát? Je ChatGPT inteligentní? A pokud ano, v čem a jak se jeho inteligence liší od té lidské? Abychom na tyhle otázky mohli odpovědět, musíme se ponořit do detailů toho, jak funguje lidské vnímání a myšlení. Do jaké míry se ChatGPT lidskému vnímání a myšlení blíží?

Lidé poznávají realitu složitým procesem, kterému teprve přicházíme na kloub. To, co plus minus víme, je, že na úplném začátku je CÍL neboli záměr, se kterým ke vnímanému přistupujeme. Necítíme a nevidíme neutrální věci, ale děje/procesy směřující k nějakému cíli. Když vidíme sklenici, nevidíme účelu-prostý, průhledný objekt, o jehož významu musíme složitě spekulovat. Vidíme něco, z čeho se dá pít (protože pití je pro naše přežití důležité). Plně objektivní vnímání je tedy iluze: vždy, bez výjimky, přistupujeme k realitě s nějakými tužbami a předpojatostmi, které vycházejí z našich hodnot (libé/nelibé, dobré/špatné, přežití napomáhající/smrtelné apod.). Ty hodnoty nemusejí být vědomé a často je vůbec nemáme pod kontrolou, protože na nejhlubší úrovni jsou vymezeny našimi biologickými danostmi a tělesnými potřebami (tedy tím, že máme tělo a musíme ve fyzické realitě nějak fungovat). Co nesměřuje k našemu cíli nebo není nějak důležité pro náš záměr, to pro nás fakticky neexistuje, viz např. známý psychologický experiment s „neviditelnou“ Gorilou. Zároveň vše nasvědčuje tomu, že naše hodnoty a cíle nelze redukcionisticky a zpětně z vnímané reality odvodit.

Cíl či záměr předznamenává a otevírá dveře k čistému VNÍMÁNÍ. Vnímání—neboli pátravé ohmatávání reality skrze smysly a pocity— je, jak se zdá, záležitostí pravé mozkové hemisféry. Pravá hemisféra, obrazně řečeno, špicuje uši a naslouchá. Její vjemy jsou ovšem neurčité, bez dalšího nedekódovatelné a low-resolution (v nízkém rozlišení). Aby bylo možno na základě vnímaného nějak jednat, musí pravá hemisféra postoupit své vjemy hemisféře levé. Ta je zaostří, zkonkretizuje, přeloží do jazyka, tedy soustavy diskrétních pojmů a kategorií a abstrahuje z nich nějaký srozumitelný závěr. Dojde k POROZUMĚNÍ. Na jeho základě pak JEDNÁME.

Výsledek jednání změní něco ve vnějším světě, což opět vyvolá nějaký pocit, který opět načte pravá hemisféra. Tím se celý kruh uzavírá.

Takto to probíhá ideálně; v praxi se ovšem může vyskytnout mnoho zádrhelů. Například můžeme nabýt dojmu, že už vše známe a všemu rozumíme. Pak je čisté vnímání (pravá hemisféra) upozaděno, a do popředí se dostane zbytnělý rozum (levá hemisféra). Přestáváme žít ve skutečném světě a uzavíráme se do světa představ.

No dobře, ale co to má společného s ChatGPT? Víc, než je na první pohled zřejmé. Na začátku je ChatGPT jako novorozené dítě. Má „nervový systém“ v podobě neuronové sítě, připravený VNÍMAT a učit se, ale ještě ani neotevřel oči. Jak se ChatGPT začne učit? Prostě ho vystavíme jeho vlastnímu „světu“, tedy obrovské haldě, doslova miliardám, nejrůznějších dokumentů na všechna myslitelná témata.

Ovšem podobně jako u lidí, ani ChatGPT nemůže vnímat bez předem stanoveného CÍLE či záměru. Zatímco u lidí se tužby, cíle a záměry rodí bůhvíodkud (tohle fakt neví nikdo, spekuluje se pouze, že to souvisí s dosud nerealizovaným potenciálem toho kterého člověka), u ChatGPT musíme cíl dodat my, lidé. Uměle a zvenku. Takovým cílem je, aby v každém textu po přečtení jeho části dokázal ChatGPT „uhádnout“ jedno následující slovo (pozn: existuje ještě nadřazený cíl, totiž aby výstupy ChatGPT v podobě reakcí na lidské prompty byly lidem užitečné, nebyly eticky problematické, nenávistné, atd; tento cíl pro zjednodušení zanedbám).

S tímto cílem už lze ChatGPT trénovat. Takový tréning je vlastně zrychlený koloběh VNÍMÁM-ROZUMÍM-JEDNÁM-VNÍMÁM-ROZUMÍM…. Tímto tréningem se stále znovu a znovu kalibruje ChatGPTí nervový systém (číselné váhy v neuronové síti), aby ChatGPT dokázal lépe a lépe reagovat na neshodu mezi jeho vlastním „cílem“ a jeho „realitou“. Můžeme také říci, že se ChatGPT učí, tzn. roste jeho POROZUMĚNÍ.

Trénování skončí, když už je dosaženo maximální možné shody mezi tím, co ChatGPT předpokládá, že bude v tom či onom textu po přečtení nějaké jeho části následovat, a mezi tím, co skutečně následuje, a další zlepšení není možné nebo je příliš pracné. Pak je ChatGPT připraven k použití. Každá další verze ChatGPT prochází stejným trénovacím cyklem, jen s jinou vstupní množinou dat a (možná, nejde o veřejnou informaci) jinou architekturou neuronové sítě (ta může mít vliv například na „paměť“ ChatGPT). V praxi se pak výstupy ChatGPT ještě korigují dalšími algoritmy strojového učení, které řeší otázky politické korektnosti, etiky apod. Tyto algoritmy už jsou založeny na zpětné vazbě od lidských uživatelů (human-reinforcement-learning). Nic víc pod kapotou ChatGPT není.

Navzdory silným paralelám mezi tím, jak fungujeme my, lidé,a tím, jak je ChatGPT trénován, jsou zde propastné rozdíly. Pochopení těchto rozdílů je klíčové, protože nám to může pomoct zmírnit všudypřítomnou paniku, že nás AI ovládne, zničí nebo zcela nahradí.

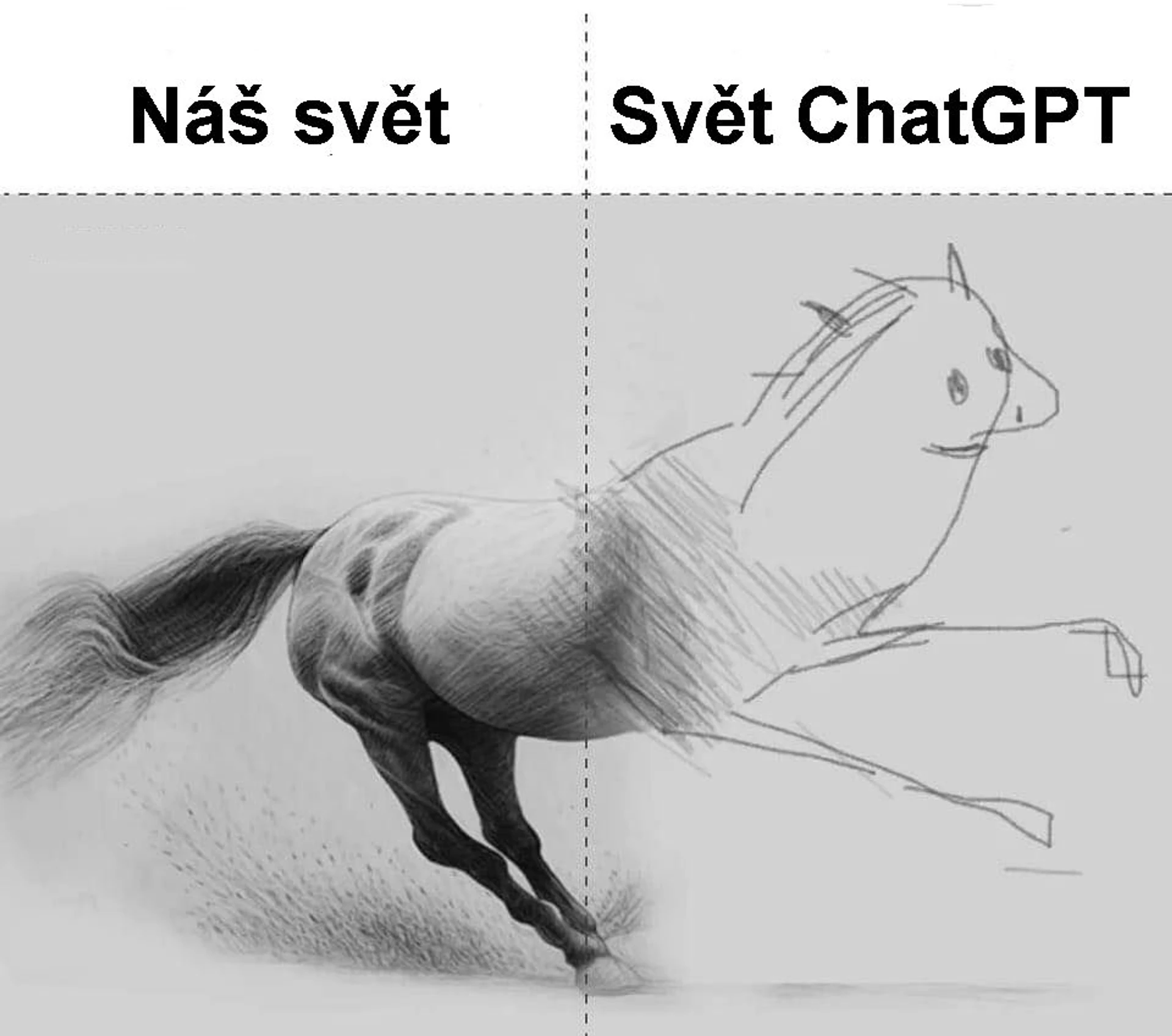

Pro začátek si všimněme, že svět lidský a svět ChatGPT (miliardy trénovacích dokumentů) se liší asi jako pravá a levá strana následujícího obrázku:

Zatímco náš svět má hloubku, svět ChatGPT je plochý, schématický a lineární. V našem světě každá jednotlivost, kterou vnímáme, souvisí s dalšími jednotlivostmi, a to nejen skrze vazby bezprostřední fyzické blízkosti, ale i skrze vazby hierarchické a temporální (časové), které nemusí být ve vnímání bezprostředně přítomny, ale přesto ho významně podkreslují. Navíc ty jednotlivosti v našem světě často nemají ostré obrysy a jejich význam je měňavý a stále se vyvíjející (Kde končí les? A kde začíná láska?).

Nejlépe je to vidět/cítit u uměleckých děl. Když se díváme na krásný obraz některého z renesančních mistrů (viz např. dechberoucí Poslední soud od Michelangela), nejde zdaleka jen o barvy a znázorněné objekty, ale o mnoho kontextů, které obraz přesahují (kontext náboženský, dobový, politický, symbolický, psychologický atd.). Obraz je pouhou branou k něčemu většímu a mnohem důležitějšímu, něčemu nevyslovenému „za ním“. To něco nelze jednoduše popsat slovy, ale přesto to každý z nás aspoň do nějaké míry cítí — jinak bychom nechodili do uměleckých galerií a netrávili v pokorném úžasu před tamními obrazy dlouhé hodiny. Ale ve světě ChatGPT je každá jednotlivost (=slovo) právě jen tím, čím je – ostře ohraničeným, zřetelně nasvíceným elementem, který je sám o sobě prostý významu, a který leží na konkrétním místě v řadě jemu podobných elementů. Není zde prostor pro víceznačnost, neurčitost, náznak, nedopovězení nebo hru protikladů. A je zde jen omezený prostor pro ironii, sarkasmus a humor.

Jinými slovy, když ChatGPT VNÍMÁ, nevnímá gestalty; vnímá už něco, co bylo (námi) předkousáno, zaostřeno, vytrženo ze souvislostí, symbolizováno a převedeno do lineární posloupnosti. Jinými slovy, funguje pouze jako levá mozková hemisféra odříznuta od pravé (což není divu, protože ho stvořili ajťáci, kteří sami takovou disbalancí hemisfér nezřídka trpí). To neznamená, že by nedokázal vnímat kontexty; to dokáže a poměrně slušně. Jde ale o to, že ty jeho kontexty jsou ploché, vykastrované, protože nejde o kontexty pociťované (tedy přirozené, cirkulární, všelijak propletené a potenciálně nikde nekončící), ale o kontexty kauzálně-lineární a umělé. Jazyk sám je velmi okleštěnou reprezentací našeho světa, protože je sám přímo výsledkem porozumění, nikoliv vnímání.

Dalším — a velmi podstatným — rozdílem je, že náš svět je studnicí poznání, která nemá dno. Nikdy nevíme, jestli za tím, co vnímáme, není ještě další level, na který zatím nevidíme (za Newtona si fyzici mysleli, že nic dalšího už nelze objevit, jenže pak přišel Einstein a otevřel dveře do zcela nové úrovně). Je to proto, že vnímání, za které jak jsme si řekli odpovídá pravá hemisféra, není nikdy dokončeno. Vždy lze pokračovat dál, hlouběji, k přesnějšímu prokreslení, větším detailům a širším souvislostem. Kdy můžeme říct, že už jsme dokonale poznali Beethovenovu Devátou?

Naproti tomu svět ChatGPT má hloubku čajové lžičky, protože je tvořen plochými a jednoznačnými texty. Ty texty nejsou takové jen proto, že jsou produktem naší levé hemisféry. Jsou ploché a jednoznačné o to více, že odkazují—z pohledu ChatGPT—pouze a jen samy na sebe. Jakmile je jednou ChatGPT přechroustá a zpracuje, je konec: nic dalšího už z nich nelze vytěžit. ChatGPT naprosto netuší, že existuje něco mimo tyto texty; něco, na co slova v těch textech poukazují a odkazují. Pro něj nejsou slova prstem, který ukazuje na měsíc; pro něj jsou tím jediným, co vůbec existuje.

Navíc ten svět ChatGPT jsme do posledního písmene stvořili my. Není v něm nic, na co bychom ještě nepřišli. A ty věci, které jsou na hraně našeho současného poznání, jsou zastoupeny tak marginálně, že se při průměrování vytratí. Není v možnostech ChatGPT vykouknout z tohoto světa ven (minimálně dokud mu nevydodáme nějaké tělo a nějaké smyslové senzory).

A jak ChatGPT dospívá k POROZUMĚNÍ? Nad jazykem, samo o sobě reprezentací reality, si ChatGPT vytváří reprezentaci další, číselnou — totiž sadu vah v neuronové síti. Nejen, že je tato druhá úroveň reprezentace ještě o poznání nepřesnější, ona se navíc odkazuje na úroveň, která je už sama o sobě abstrahovaná, zjednodušená a linearizovaná. Takže tu máme zkreslení na druhou. Něco jako levá hemisféra na steroidech.

Pak je tu ještě ten zádrhel s prvotním záměrem či CÍLEM. ChatGPT se nenaučil doplňovat slova sám od sebe proto, že by chtěl, že by ho to bavilo a naplňovalo. Tento cíl jsme mu podsunuli my, lidé. Zajisté je možné mu podsunout mnoho jiných cílů, třeba aby každé větě přiřadil emoci. Nebo tón, nebo barvu, nebo chemický prvek. Ty možnosti jsou bezbřehé, ale nic z toho se nestane bez toho, že by to někdo z lidí považoval za rozumné, sehnal k tomu ohromnou sadu trénovacích dat, alokoval na to výpočetní zdroje a zaplatil to. Jinými slovy, aby to podřídil daleko většímu a širšímu záměru.

Poslední rozdíl je v tom, že ChatGPT má stabilní architekturu (strukturu neuronové sítě), která byla opět stanovena předem a zvenku. Náš mozek má naopak architekturu flexibilní, proměnlivou, adaptivní. Nejenom, že náš mozek doslova do písmene nestále přestavuje sám sebe, ale ještě, jak se ukazuje, je schopen nějakým záhadným způsobem optimalizovat míru redundance neuronových spojení tak, aby jich nebylo ani příliš mnoho, ani příliš málo. Zjevně to celé řídí nějaká vyšší inteligence, o níž nemáme ani šajnu :-)

Pro netechnicky založené, je možné si ChatGPT přiblížit pomocí následující, poněkud morbidní představy. Představme si, že nějaký novodobý Dr. Frankenstein vyšlechtil pomocí genetického inženýrství lidské mládě —schválně nepíšu dítě—s velmi vysokým IQ, obrovskou mozkovou kapacitou a vysokou psychickou odolností. Mládě pojmenoval Arnošť. Arnošt vyrůstá zavřený v odhlučněné, bíle vypolstrované místnosti s tlumeným světlem, bez oken a s filtrovaným vzduchem, kterou nesmí opustit. Veškeré jídlo, které Arnošt dostává, je bílá, každý den jedna bílá želatinová kostka — něco jako amaróny ze seriálu Návštěvníci (nutričně bohaté, ale bez chuti, bez zápachu). Na pití má pouze destilovanou vodu. Jediný kontakt se světem okolo, který Arnošt má, jsou setkání se svým stvořitelem, který za ním chodí na 8h denně, osprchovaný, do hladka oholený a oblečený ve škrobeném laboratorním plášti. Dr. Frankenstein s Arnoštem libovolně rozmlouvá, ovšem pouze přes skleněnou stěnu. Kromě toho má Arnošť neomezenou zásobu knih na libovolné téma, ve všech světových jazycích. Ale bez obrázků, aby se nerozptyloval.

Řekněme, že Arnošt nějakým zázrakem překoná nelidskou citovou i smyslovou deprivaci a postupně se naučí číst. V čem bude jeho pochopení čteného odlišné od toho našeho? No, stejně jako my se dočte z knih o existenci barev a chutí, a o mnoha dalších úžasných věcech ve vnějším světě. Jenže nic z toho nemá možnost vidět, ochutnat, sáhnout si na to a nic z toho pro něj nemá žádný hlubší smysl. Ví, že existuje něco jako hruška a něco jako jablko, a že některá jablka jsou kyselá a jiná sladká. A že kyselý je ještě citrón a sladký je ještě polibek. Ale netuší, co polibek znamená, a že nejde o věc, ale o akt. Všechna tahle slova jsou pro něj jen významu prosté řetězce znaků vyskytující se ve stejně vyprázdněných souvislostech.

Označili bychom Arnošta za inteligentního? No, zajisté by s ním bylo možno vést filosofickou diskusi, ale obávám se, že po deseti minutách by to každého z nás přestalo bavit. Možná bychom byli chvíli ohromeni jeho fenomenální pamětí a širokou slovní zásobou, ale to by bylo tak asi vše. O ničem lidském by Arnošt neměl ani tušení a byl by to, upřímně řečeno, pěkně nudný patron. Možná bych se na něj šel podívat do cirkusu, ale na pivo bych ho nepozval.

Arnošt je prostě vědomostmi napěchovaný hlupák, který nic z toho, co ví, neumí nijak použít a vlastně vůbec nechápe, co vlastně ví. Totéž v mnohem větší míře platí o ChatGPT. Na rozdíl od Arnošta, nemá ChatGPT ani stopy vlastní vůle, natož pak toho, co z nedostatku lepšího slova nazýváme vědomím.

Obavy, že se blížíme jakési singularitě, zlomovému okamžiku, kdy si AI uvědomí sama sebe a vzbouří se proti lidstvu, jsou proto podle mě liché nebo aspoň nesmírně předčasné. Můžeme klidně spát.

To ale vůbec neznamená, že by ChatGPT a jemu podobné technologie nemohly napáchat obrovské škody. Nebude to ale ani náznakem proto, že by nabyly vlastní vůle nebo vědomí, ale čistě proto, že jim my lidé neuváženě svěříme do ruky přílišné pravomoci.

Pomozme si opět příkladem Arnošta. Co když budeme Arnoštovi v reálném čase transkribovat diskuse armádního štábu v Izraeli a necháme ho přijmout rozhodnutí o tom, kdy už odpálit rakety na Palestinu? Arnošt ty rakety v klidu odpálí, protože si něco podobného přečetl v nějakém dvacet let starém scifi. A nebude mít ani šajnu, co to vlastně dělá.

Právě v tomto a pouze v tomto tkví skutečné nebezpečí ChatGPT. Zbytek jsou podle mého názoru jen liché obavy, sci-fi fantazie a marketing.

Zdroje:

Jordan Peterson, Maps of Meaning

Iain McGlichrist, The Master and His Emissary: The Divided Brain and the Making of the Western World

Jordan Peterson a John Vervaeke: A Conversation So Intense It Might Transcend Time and Space